ゴミ捨てロボットは人間の敵を激怒させる

ゴミ捨て話はゲームの対戦相手を混乱させるために長い間使用されてきた戦術でしたが、今の新しい研究は、落胆する言葉がロボットから来た場合でもゲームプレイに影響を与える可能性があることを示しています。

研究のごみの話は明らかに穏やかで、「あなたはひどいプレーヤーだと言わざるを得ない」や「ゲームの進行中にあなたのプレーは混乱しました」などの発話がありました。それでも、ロボットで特定のゲームをプレイした人々(Pepperとして知られている市販のヒューマノイドロボット)は、ロボットが彼らを落胆させたときはより悪く、ロボットが彼らを奨励したときはより良くなりました。

主執筆者のアーロンM.ロス氏は、40人の研究参加者の一部は技術的に高度であり、機械が不快感の原因であると完全に理解していたと語った。

「ある参加者は、「ロボットが言っていることは好きではありませんが、それがプログラミングの方法なので、それを責めることはできません」とカーネギーの修士課程の学生である研究を実施したロスは言いました。メロン大学(CMU)ロボット工学研究所。

しかし、研究者たちは、参加者の技術的な知識に関係なく、全体的に人間のパフォーマンスが変動することを発見しました。

先月、インドのニューデリーで開催されたIEEE International Conference on Robot&Human Interactive Communication(RO-MAN)で発表されたこの研究は、人間とロボットができる最善の方法に焦点を当てる傾向がある、典型的な人間とロボットの相互作用研究からの出発です。共に働く。

「これは、協力していない環境での人間とロボットの相互作用に関する最初の研究の1つです」と、ソフトウェア研究所の助教授であるDr. Fei Fangは述べています。

この研究は、人工知能機能を備えたロボットとモノのインターネット(IoT)デバイスの数が指数関数的に増加すると予想される世界に大きな影響を与えます。

「ホームアシスタントは協力的であることが期待できますが、オンラインショッピングなどの状況では、私たちと同じ目標を持っていない可能性があります。」

この研究は、Fangが教えるコースの学生プロジェクトの成果です。学生は、ロボットのコンテキストでのゲーム理論と制限された合理性の使用を探求したかったため、「ガードと宝物」と呼ばれるゲームで人間がロボットと競争する研究を設計しました。いわゆるStackelbergゲームで、研究者はこれを使用して合理性を研究しています。ファングはそれを彼女のサイバーセキュリティ研究に採用して、防御者と攻撃者の相互作用を研究しています。

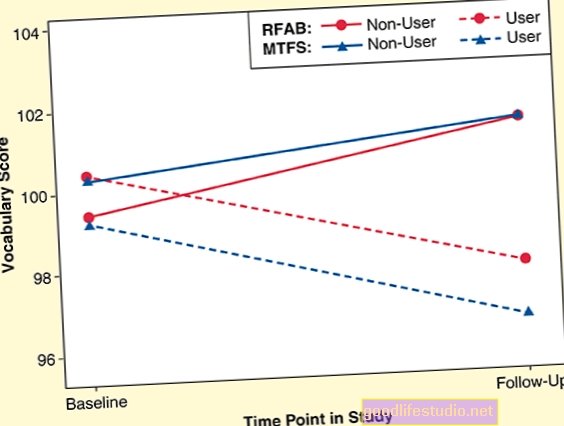

調査では、各参加者がロボットで35回ゲームをプレイしながら、ロボットからの励ましの言葉を楽しんだり、否定的な発言で慌ただしくなったりしました。プレーするゲームの数が増えるにつれて人間のプレーヤーの合理性は向上しましたが、ロボットに批判された人や賞賛された人は得点しませんでした。

CMUのヒューマンコンピューターインタラクションインスティテュート(HCII)のシステムサイエンティストのシステムサイエンティストであるアフサネドリャブ博士は、人のパフォーマンスは他の人の発言に影響されることはよく知られていますが、人間も機械の発言に反応することがわかっていますバージニア大学で工学システムおよび環境の助教授を務め、現在は助教授を務めています。

このマシンの応答を促す機能は、自動学習、メンタルヘルス治療、さらにはロボットをコンパニオンとして使用することにも影響を与える可能性がある、と彼女は述べた。

将来の研究は、ロボットと人間の間の非言語的表現に焦点を当てるかもしれません、とロスは言いました。メリーランド大学の学生。 Fangは、さまざまな種類のマシン(たとえば、コンピュータボックスと比較した場合のヒューマノイドロボット)が人間にさまざまな反応を引き起こす可能性があることについて、さらに学ぶ必要があることを示唆しています。

出典:カーネギーメロン大学