秘密の文書:Facebookはユーザーの安全性よりも機能や利益を重視しているように見える

12億3300万人のアクティブユーザーを抱える13歳の巨人であるFacebookは、四半期ごとに80億ドルを超える収益を生み出しています。そのうち30億ドルは純利益(例:利益)です。

しかし、非常に多くのユーザーがいるため、Facebookはユーザーの安全を二次的な懸念に追いやったようです。今年の初めまで、Facebookはコンテンツをレビューするために4,500人しか雇用していませんでした。 12億3千万人のアクティブユーザーが共有していることに気づくまで、多くの人に聞こえます 数十億 Facebookのコンテンツに関する何百万ものユーザーからの苦情が毎日提出されており、

Facebookはユーザーの安全に深刻な問題を抱えていますか?公開されたばかり ガーディアン 秘密の内部文書のレビューは、その問題が制御不能であることを示唆しています。

Facebookは、ある種の問題があることを認めた。今年初め、同社のレビュースタッフをほぼ2倍に(7,500に)することに同意した。同社は、潜在的に有害なコンテンツがプラットフォーム全体にトラフィッキングされた場合、十分に対応しない(または気にしていない)との申し立てがあったためだ。 。すべてが順調なものである場合、モデレートスタッフを2倍にしないでください。

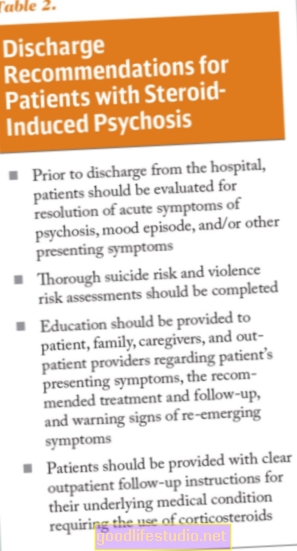

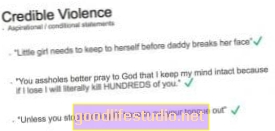

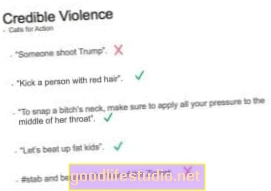

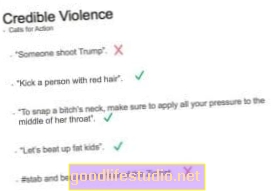

さて、 (英国)ガーディアン は、100を超える秘密の内部トレーニングマニュアルとドキュメントを抜粋して、Facebookのコンテンツ管理ガイドラインの驚くべき詳細を公開しています。 Facebookのモデレーターが雇用されたときに提供される1つのマニュアルには、これらすべての重要な情報が含まれていないので、少し邪魔になります。代わりに、それはポリシーへの断片的なアプローチであるように見え、結果として矛盾する情報、不均一なモデレーション、およびそのモデレートポリシーが実際に実際に機能する方法にほとんど信頼性がないように見えます。

「フェイスブックはそのコンテンツを管理することができない」とある情報筋は述べた。 「それはあまりにも大きく、速すぎました。」

多くのモデレーターは、一部のポリシーの不整合と固有の性質について懸念を持っていると言われています。たとえば、性的なコンテンツに関するものは、最も複雑で混乱していると言われています。

Facebookが管理するコンテンツ量のほんの一部の例として、記事は「FacebookはFNRP(偽装、実在の人物ではない)として知られている、偽の可能性のあるアカウントに関する週に600万件を超えるレポートをレビューするという1つの文書」と述べています。そして、それは偽のアカウントのためだけのものです。実際のコンテンツについて何百万ものレポートがあると想像してください。

考える前の機能

人々が新機能をどのように使用(および乱用)するかについて考える前に、Facebookは、物事を展開し、それを後付けとしてモデレートする方法を考え出すことを好むようです。 Facebookライブをご覧ください。これは、人々が現在の生活の中で起こっていることをすべてビデオでストリーミングできるビデオストリーミングサービスです。彼らは人々が最終的にそれをどのように使用すると思いましたか?

これは、問題を常に考え、問題が発生する前に積極的に対処することの欠如を示しています。または、「ちょっと、これで転がして、それについて何かする前に、どのような抗議が出るのか見てみましょう。」 (もちろん、「言論の自由」という名のもとに、Facebookがグローバルなプラットフォームであるという事実を無視しています。)1

そのモデレートガイドラインをどこに再配置しましたか?

そして、たぶんそれらすべてを単一のマニュアルに入れますか?それで、モデレーターはどこを見ればよいかを知っており、すべてのガイドラインに一貫性がありますか?

Facebookの世界では、自傷行為の動画は完全に問題ありません。なぜなら、その人は「苦痛」にあるからです。動物の残酷さも同様です(恐らく動物が苦痛にあるためでしょうか?)。 「リベンジポルノ」も、モデレーターが両方の当事者の同意の欠如を確認できない場合は問題ありません(おそらく、タイムリーに行うのはかなり難しいと思います)。

「性的虐待や子供のいじめの写真の中には、サディスティックな要素やお祝いの要素がない限り、削除または「対応」する必要のないものがあります。」暴力的な画像や動画にサディズムやお祝い事を入れない限り、明らかにFacebookが許可します。

文書によると、「暴力的な死のビデオは邪魔ですが、意識を高めるのに役立ちます。動画については、未成年者には保護が必要であり、成人には選択が必要だと思います。私たちは人間の暴力的な死の「不穏な」ビデオとしてマークを付けます。」ライブビデオや脅威などの自殺コンテンツがFacebookのモデレートポリシーのどこに該当するかは明確ではありませんが、許可されているようです。

Facebookはユーザーの安全を優先する必要がある

Facebookがこのすべてのコンテンツのゲートキーパーであるため(Facebook放送局がネットワーク上のコンテンツのゲートキーパーであるように)、Facebookをより厳しく規制するように要求する人もいます。

5月1日に発行されたイギリス国会議員の報告によると、「最大かつ最も裕福なソーシャルメディア企業は、違法または危険なコンテンツへの対処、適切なコミュニティ基準の実装、またはユーザーの安全維持のために十分な行動を取ることは恥ずべきことではありません。」

「言論の自由」の側面に誤りを犯すことは、特にアメリカの企業にとっては良い考えのように思えるかもしれません。しかし、ソーシャルネットワークは主にオンラインコミュニティです。新聞とはあまり異なります。 Facebookの主な目的は、人々を互いに結びつけることです。彼らのガイドラインは、このような多様性をより反映し、ある種のニュース発行のマントラや空のイデオロギーではなく、そのコミュニティの安全のために設計されたということになります。

Facebookが毎日何百万人もの人々やコンテンツを管理する方法について、より透明性が高くなることを望んでいます。これらの問題にさらに光を当てることは、問題を指摘するのに役立ち、Facebookにコミュニティの安全性を向上させる機会を与えます。また、Facebookがプラットフォームの安全を維持するのに十分なスタッフを確保するために、Facebookの収入を大幅に増やすことを期待しています。すべてのユーザー向け。

詳細については

脚注:

- ああ、そしてFacebookのフォロワーが10万人以上いる場合、その目には「有名人」になり、一般の人々のプライバシーやその他の保護の対象とはなりません。 [↩]